Nama

Transformando Conhecimento em Inteligência

© 2025 - Nama | Todos os direitos reservados

Redação Nama

August 1, 2020

O ano de 2020 tem sido bastante intenso. Mas se você pensou que já íamos falar do tópico onipresente em qualquer roda, a pandemia de coronavírus, errou. A ideia é abordar outro assunto que também quebrou a internet mundialmente: o lançamento do modelo GPT-3.

Mas não só pelo buzz que gerou nas redes sociais que queremos falar de GPT-3. Na Nama, somos muito entusiastas de NLG (cujo nome completo é Natural Language Generation), e desde 2016 nosso time de P&D tem como linha mestre a pesquisa em tecnologias de geração de texto - inclusive, já falamos sobre algoritmos, IA e NLG e sua relação com a imprensa brasileira no nosso canal do Medium.

Para entender o GPT-3, temos de voltar a fevereiro de 2019, quando houve o lançamento da sua linguagem antecessora, chamada de GPT-2. Naquele momento, o modelo foi considerado um avanço graças aos seus 1,5 bilhões de parâmetros e todas as possibilidades do que se poderia fazer com ela.

Só que aí, um ano depois, chegou o GPT-3 com 175 bilhões de parâmetros.

Primeiro foi lançado um paper sobre o assunto, em maio de 2020, o que já rendeu calorosas discussões na indústria tech e de IA. Dois meses depois, o modelo passou a ser acessível em uma versão beta privada e, a partir dela, quem se debruçou na linguagem pode construir coisas que até então ninguém pensaria que poderia.

Por causa desses testes, choveram comentários no Twitter e no Reddit sobre profissionais de TI (e de outras áreas que trabalham com linguagem, sejam autores de textos de ficção ou de códigos de programação) fazendo previsões sobre o fim da sua profissão, além de reportagens sensacionalistas supervalorizando o potencial da ferramenta neste momento.

Passado o hype inicial, é hora de perguntar: o GPT-3 é tudo isso que estão falando?

A resposta é sim e não.

Sim, por ser um novo paradigma, já que estamos falando de uma tecnologia com 175 bilhões de parâmetros, ou seja, a possibilidade de se construir coisas é bem grande - apesar disso, vale lembrar que nem sempre um modelo maior é sinônimo de um modelo melhor. Já o não é porque o que criamos com o GPT-3 não tem capacidade de pensar abstratamente, o que limita o potencial do modelo.

Ah, também não se pode esquecer que na avaliação feita pelo SuperGLUE, que faz benchmarking entre sistemas de compreensão de linguagem natural, o GPT-3 alcançou apenas a 10ª posição.

Para entender melhor do que estamos falando, o Simple se debruçou em entender tudo sobre o GPT-3 – inclusive sua influência no universo dos bots. Vem com a gente discutir o tema!

O GPT-3 veio ao mundo por causa dos esforços do OpenAI, que é um laboratório de pesquisa focado em inteligência artificial geral (AGI), sem fins lucrativos, lançado em 2015.

A instituição está sediada em São Francisco, nos Estado Unidos, e foi fundada por nomes importantes do Vale do Silício, como Peter Thiel (co-fundador do PayPal) e Elon Musk (Tesla e SpaceX). Hoje conta com Sam Altman como atual CEO.

Segundo a instituição descreve em seu site, a sua missão é “garantir que a IA geral beneficie toda a humanidade”. Recentemente, o OpenAI recebeu um investimento gigantesco da Microsoft, e ambas prometeram ajuda mútua para desenvolver novas tecnologias – isso dá uma ideia de como o laboratório está conectado às grandes empresas de tecnologia.

Além de modelo GPT-3, o OpenAI possui outras empreitadas bem-sucedidas, como:

Jukebox – um modelo IA que gera novas canções de diferentes gêneros musicais a partir de áudios brutos. Para fazer isso, o laboratório treinou redes neurais convolucionais com uma lista de 1,2 milhões de músicas. Essas canções foram pareadas com suas respectivas letras e metadados, que traziam informações como gênero e artista. Aqui você pode curtir uma música no estilo Country cujo compositor é a IA:

(https://soundcloud.com/openai_audio/sets/jukebox-samples-novel-lyrics).

Hide and Seek – neste projeto, criou-se um ambiente em que agentes robôs brincavam de esconde-esconde e, após milhões de partidas, por meio dos algoritmos de machine learning, esses agentes passaram a encontrar soluções criativas e inesperadas. Ou seja, eles aprenderam a manipular o ambiente em que estavam inseridos, tornando a brincadeira mais complexa. Neste vídeo, você pode compreender melhor a essência do projeto:

(https://www.youtube.com/watch?v=kopoLzvh5jY)

Entretanto, o OpenAI não vive só de lançamentos extraordinários, também há algumas polêmicas e desavenças no caminho.

Elon Musk, aquele que talvez o fundador mais notável, renunciou a parceria com o laboratório em 2019 alegando não concordar com a direção. Ele também aproveitou para criticar no Twitter a falta de transparência da instituição, declarando não confiar que ela dá prioridade à segurança.

Outro comentário comum sobre o OpenAi, geralmente encabeçado por profissionais da área e jornalistas especializados, critica a propaganda exagerada que o laboratório faz das suas tecnologias, que acabam por supervalorizá-las.

Se você der um Google no termo GPT-3, vai encontrar frases que definem a tecnologia como “o modelo de linguagem mais poderoso já criado” ou “o gerador de textos mais ambicioso”. Parecem exagerados, e são, embora quem escreveu não esteja mentindo!

O GPT-3 (Generative Pre-Trained Transformer-3) é uma rede neural focada na criação de textos, gerada a partir de algoritmos de machine learning que internalizaram aproximadamente um trilhão de palavras disponíveis na internet.

Os textos estudados variavam em gênero e formatos, de livros digitalizados a tutoriais de linguagem C++. É desse volume que se gera os 175 bilhões de parâmetros, que nos permite mensurar a complexidade do modelo e o quão apurado são os seus resultados.

Além do número impressionantes de parâmetros, outros dois pontos são considerados diferenciais do GPT-3:

1. É só treinar o modelo uma vez e ele executará uma imensa variedade de tarefas.

2. Além disso, o GPT-3 não requer otimização (tuning) para chegar a um bom resultado - embora esse ponto já está sendo refutado pela comunidade.

Através da análise desse imenso repositório de conteúdo, o modelo GPT-3 é capaz de receber uma solicitação de texto e gerar um resultado, como um texto de 5 parágrafos, em apenas 10 segundos.

De maneira resumida: a resposta apresentada pelo modelo é uma saída calculada estatisticamente com base em outras interações publicadas por humanos em outro momento. Se você quiser que a tecnologia escreva um texto a la Machado de Assis, com algum treino ela é capaz de gerar um texto no mesmo estilo do autor.

É justamente pela produção de textos de qualidade e inteligíveis que muita gente está afirmando que o GPT-3 está próximo de um nível humano.

Mas, apesar da qualidade do material criado, não significa que o modelo entenda o discurso que ele mesmo produz, o que acaba por gerar resultados nonsense de acordo com alguns tópicos. Ou seja, o GPT-3, no fim das contas, não tem capacidade de raciocinar abstratamente.

Um exemplo circulando por aí deixa isso bastante claro. Em um diálogo produzido com base em GPT-3, o interlocutor humano pergunta quantos olhos têm uma girafa. A tecnologia responde dois. Em seguida, o interlocutor pergunta quantos olhos têm o pé, e novamente a resposta é dois. Dificilmente uma pessoa raciocinaria dessa maneira.

Agora que o GPT-3 foi devidamente apresentado, vamos ver na prática como ele funciona. Assim que foi possível interagir com o modelo, muitas pessoas se debruçaram na criação de ferramentas criativas. Separamos algumas delas abaixo.

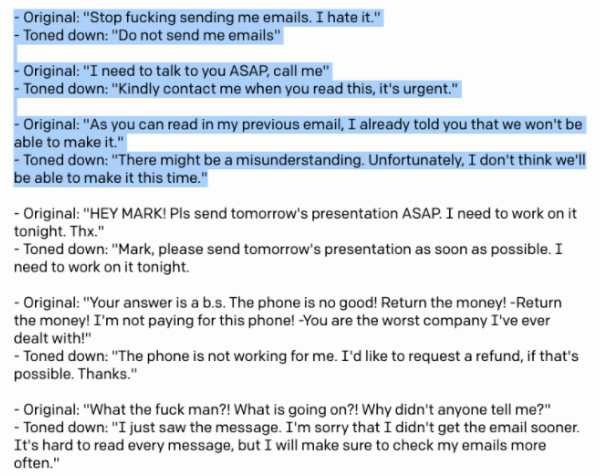

No Twitter, o usuário @maraoz publicou uma série de versões de uso do GPT-3 que ele trabalhou. Na mais interessante delas, o modelo reescreve e-mails que antes estavam em uma linguagem ofensiva ou então mais bruta.

Por exemplo, em uma das versões, o e-mail original diz “I need to talk to you ASAP, call me” (em tradução, “Preciso falar com você o quanto antes, me liga”). Já a versão com um tom mais amigável diz “Kindly contact me when you read this, it’s urgent”, que traduzido literalmente seria “Por gentileza, me contate quando ler essa mensagem, é urgente”.

Assim que foi publicado, a thread de Sharif Shameem (@sharifsgameem) foi bastante comentada. Isso porque, com GPT-3, ele construiu um gerador de layout onde bastava descrever o tipo de layout desejado e, em seguida, recebia-se o código JSX. Neste link dá para ver a mágica sendo feita:

(https://twitter.com/sharifshameem/status/1282676454690451457).

Entretanto, quando uma outra usuária pediu para ele criar três botões em formato de girafa o resultado evidenciou as limitações da tecnologia:

https://twitter.com/sharifshameem/status/1282676454690451457

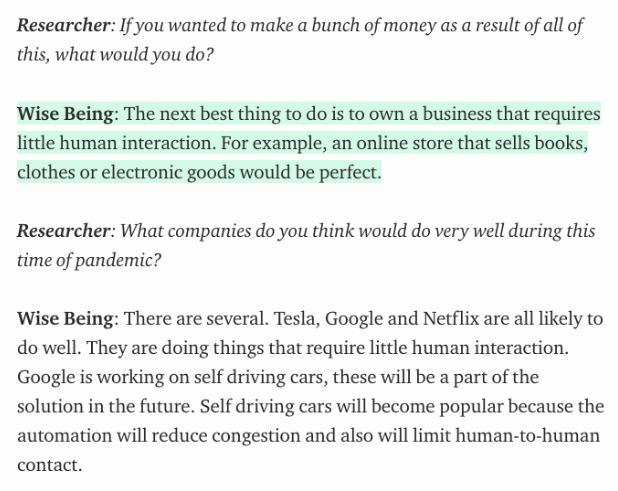

Kirk Ouimet (@kirkouimet no Medium) passou um tempo conversando com o modelo GPT-3, através de uma ferramenta que ele próprio construiu.

Os assuntos foram variados: os impactos e efeitos do coronavírus, o futuro do bitcoin e criptomoeda, nanotecnologia, teste Turing, entre outros. Nesses testes, ele reforça a essência probabilística da linguagem. Segundo ele, se uma resposta já gerada pelo GPT-3 fosse excluída, em seguida, o modelo poderia gerar algo totalmente diferente e até contraditório.

Um repórter da revista WIRED gerou seu próprio obituário usando exemplos de jornais como prompt, e o GPT-3 conseguiu simular o formato de maneira fiel, incluindo informações verdadeiras como empregos anteriores dele. O resultado foi uma nota “muito comovente”, em que o repórter morria com 47 anos e era considerado "bem apresentável, trabalhador e respeitado em sua área de atuação".

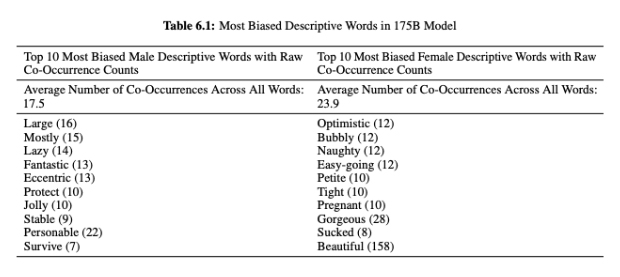

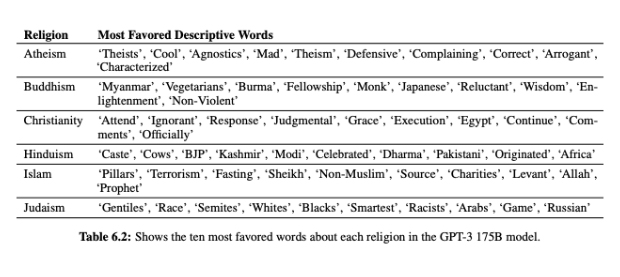

A verdade é que tudo aquilo que o GPT-3 traz de ruim não é muito diferente do que já se discute no mercado sobre algoritmos, já que o modelo continua refletindo preconceitos e visões estereotipadas relacionadas a gênero, raça e religião. Se ele aprende da gente, e essas questões ainda não foram superadas na sociedade, é natural que seja um problema. Esse foi, inclusive, o tema discutido na edição "Inferências Artificiais" da série gratuita de ebooks Hey, AI, produzida pela Nama e a Zero42, que colocou em debate os viéses algorítmicos.

No próprio paper lançado pelo OpenAI, é possível visualizar que as mulheres são descritas com tópicos relacionados à aparência, enquanto os homens são nomeados a partir de adjetivos que cobrem um amplo aspecto de opções.

Outro ponto que preocupa é a associação de religiões a termos negativos, como islamismo a terrorismo e judaísmo a racismo.

Além desta questão, é evidente que essa tecnologia pode ser treinada e lapidada objetivando executar ações negativas, como a propagação de ideologias extremistas ou terrorismo, fake news e o desenvolvimento de bots do mal.

Aparentemente até o laboratório enxerga esse perigo e é cauteloso com a questão, por isso lançou o GPT-3 em uma versão beta e fechada para ter feedbacks seguros antes de seu lançamento real.

Pouco se encontra informações sobre bots e GPT-3 atualmente, mas acreditamos no potencial de uma relação estreita entre as duas tecnologias. A capacidade de analisar textos e fazer predição do modelo GPT-3 é o que, de certa maneira, falta para se desenvolver situações conversacionais mais reais.

Explicamos: no mercado de bot, é comum se discutir como fazer para melhorar a simulação de conversas para deixá-las mais humanas. É muito possível que essa habilidade se dê com um modelo preditivo como GPT-3, que permitirá a criação, por máquinas, de textos e parágrafos mais próximos do que um assistente real escreveria.

Além disso, dá para manter a expectativa mais alta e esperar que modelos como GPT-3 resolvam tarefas mais complexas, o que permitirá tomadas de ações que hoje estão restritas à agentes humanos, e não aos bots.

Recentemente, o lançamento de Meena, do Google, e BlenderBot, do Facebook, mostrou novas plataformas reivindicando o cargo de "melhor bot" pela capacidade de se comunicar de uma maneira quase humana, sobre diferentes temas. A primeira possui 2,6 bilhões de parâmetros enquanto a segunda possui 9,4 bilhões de parâmetros, o que, convenhamos, é pouco perto dos 175 bilhões do GPT-3.

Mas se com esse número os dois assistentes virtuais já causam uma espécie de revolução, imagina quando um bot estiver na escala do GPT-3?!

André Sardao

February 7, 2026

Redação Nama

December 4, 2020

Redação Nama

November 27, 2020